Milagros Miceli, investigadora argentina reconocida por la revista Time entre las 100 personas más influyentes en inteligencia artificial, expuso las dimensiones ocultas de la industria tecnológica de automatización durante un conversatorio organizado por Santex en Buenos Aires.

La especialista, que dirige el proyecto Data Workers Inquiry, resumió la materialidad de estas tecnologías en una palabra: explotación.

“Estamos hablando de la explotación de nosotros como seres humanos, la explotación del trabajo y la explotación de recursos naturales de nuestros territorios”, afirmó.

La industria invisible: millones trabajando para la IA

Según Miceli, entre 250 y 430 millones de personas alrededor del mundo trabajan en tareas fundamentales para la inteligencia artificial —etiquetado de datos, moderación de contenido, verificación— en condiciones altamente precarias.

“Es más o menos la población total de Estados Unidos o de la Unión Europea. No es un número marginal”, señaló.

La investigadora explicó que este trabajo se terceriza deliberadamente a regiones del sur global donde las regulaciones laborales son laxas.

Infografía generada por IA.

“Hay una intencionalidad en reclutarlas en estos lugares específicos. Buscarlos y buscarlas en lugares donde si vos cuestionás y te echan no vas a tener otra posibilidad”, explicó.

El Banco Mundial estima que estos trabajadores operan mayormente a través de plataformas sin relación de empleo, sin protección social ni sueldos fijos, ganando en muchos casos centavos por tarea completada.

El robo de propiedad intelectual como modelo de negocio

Miceli denunció que muchas tecnologías de IA generativa se basan en el robo de propiedad intelectual de artistas, periodistas y escritores. “Se ha tomado sin permiso para producir conjuntos de datos que terminan entrenando estas tecnologías”, indicó.

La especialista invitó a los periodistas presentes a preguntarle a ChatGPT cuáles son las fuentes que contribuyeron a su entrenamiento. “Te va a dar una lista larguísima de todos los medios periodísticos del mundo. Y probablemente tu trabajo haya sido usado para el entrenamiento de esta herramienta comercial”, advirtió.

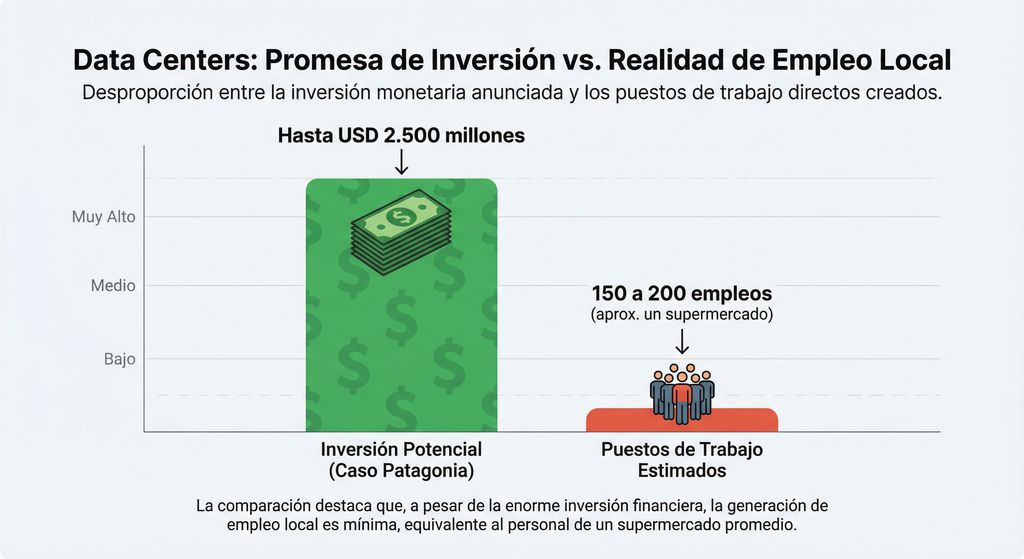

Data centers: la amenaza ambiental concreta

Al referirse al proyecto Stargate anunciado para la Patagonia argentina, Miceli cuestionó la falta de precisiones sobre la inversión anunciada de hasta 2.500 millones de dólares. “No sabemos ni cómo ni cuándo ni quién la va a traer (luego aclara que será OpenAI quien llegará al país), en qué forma, no sabemos a quién va a afectar, dónde efectivamente se va a instalar”, señaló.

Gráfico generado por IA.

La investigadora explicó que los data centers requieren agua fresca y limpia para refrigeración y consumen cantidades enormes de electricidad. “Estamos en un país donde la Patagonia realmente también sufre de sequías. No es que estamos en un lugar donde podemos regalar electricidad”, advirtió.

Citando experiencias en Chile, México y otros países de la región, Miceli alertó sobre plantas de energía altamente contaminantes que suelen acompañar estos proyectos.

“Un data center no crea más allá del boom de la construcción más de unos cientos de trabajos. Estamos hablando de 150 a 200 empleos”, precisó.

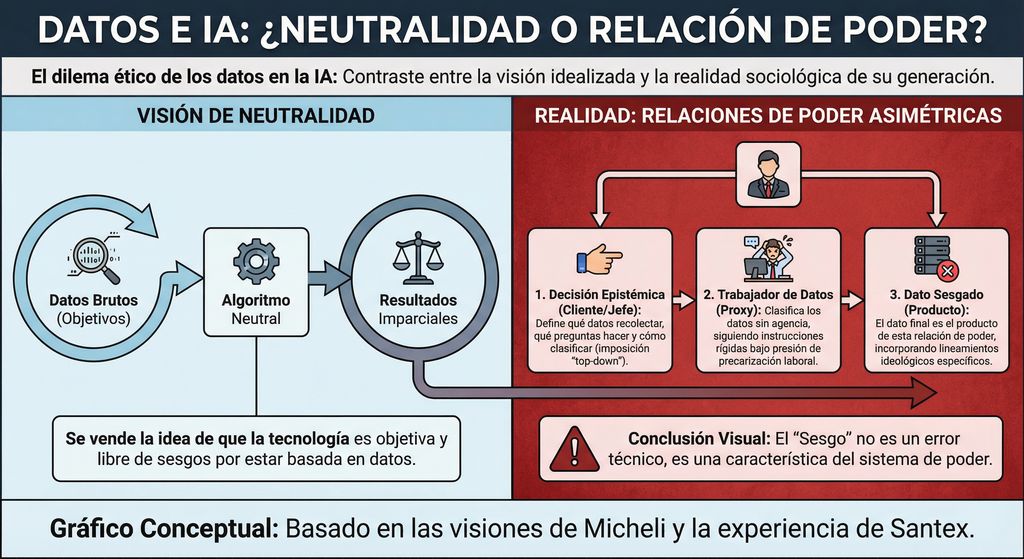

La neutralidad de los datos: un mito peligroso

“El dato es el producto de relaciones de poder asimétricas”, afirmó Miceli, citando el libro Feminismo de datos.

La especialista explicó que siempre hay alguien con poder epistémico que decide qué datos se recopilan, cómo se interpretan y qué visiones del mundo reproducirán los modelos.

“Las tecnologías de IA son tecnologías de clasificación, epistémicas: son maquinas de imponernos verdades”, indicó.

Gráfico generado por IA.

Compartió ejemplos de instrucciones dadas a trabajadores de datos que imponían clasificaciones binarias de género sin posibilidad de cuestionar.

“Más allá del juicio de valor, es importante entender que tienen un lineamiento ideológico muy específico y que es imposible escapar de esos lineamientos ideológicos”, explicó.

“No estoy criticando la tecnología en sí, estoy criticando la concentración de poder que producen estas tecnologías en manos de unas pocas empresas que terminan enriqueciéndose de forma desmedida”, enfatizó.

Muchas compañías creen que no hay negocio detrás de la ética. Ese es el verdadero problema.

Juan Santiago, CEO de Santex

El ejecutivo respaldó así el planteo de Miceli desde la perspectiva empresarial.

El llamado a la acción desde el sector privado

Santiago cuestionó el modelo de negocio basado en explotación: “¿Por qué pueden sacarle la propiedad intelectual a los escritores, a los periodistas, a los artistas? Porque son megacorporaciones las que están defendiendo sus derechos, mientras un artista que toca en la esquina no tiene fuerza para pelear”.

La investigación demuestra que tratar bien a los trabajadores de datos no solamente crea mejores conjuntos de datos, sino que se ahorra dinero porque las cosas se hacen bien mucho más rápidamente.

Walter Abrigo, socio y director General de Santex

Regulación: proteger al usuario, no al corporativismo

Sobre regulación, Santiago fue contundente: “El problema con la regulación es que tiene una connotación negativa. Regular no es frenar la inversión, frenar la innovación, frenar el progreso”.

El ejecutivo planteó que las empresas deben poder hacer negocios pero compensando el impacto ambiental y social. “El problema es que el dinero se metió en la política y la política se metió en el dinero. La regulación que debería protegernos como usuarios protege al corporativismo”, sentenció.

Miceli concluyó alertando sobre el riesgo de perder la capacidad de imaginar alternativas. “Es muy importante que no nos roben el poder de imaginar alternativas. Es importante imaginarse alternativas”, enfatizó.

El conversatorio forma parte de las iniciativas de La Liga del Bien para la Inteligencia Artificial, promovida por Santex, que ofrece instrumentos gratuitos para que estados y empresas evalúen el desarrollo ético de sus implementaciones de IA.